Le refuge entre nature, technologie et humain.

Vivre avec l’IA sans s’y perdre — une réflexion au bord de l’océan

J'utilise l'IA chaque jour. Je marche au bord de l'océan régulièrement. Les deux ne se réconcilient pas facilement — mais j'apprends à tenir la tension sans mentir.

⏳ Vivre avec l’IA sans s’y perdre – Temps de lecture ~10 minutes

Introduction — entre Nature et Technologie

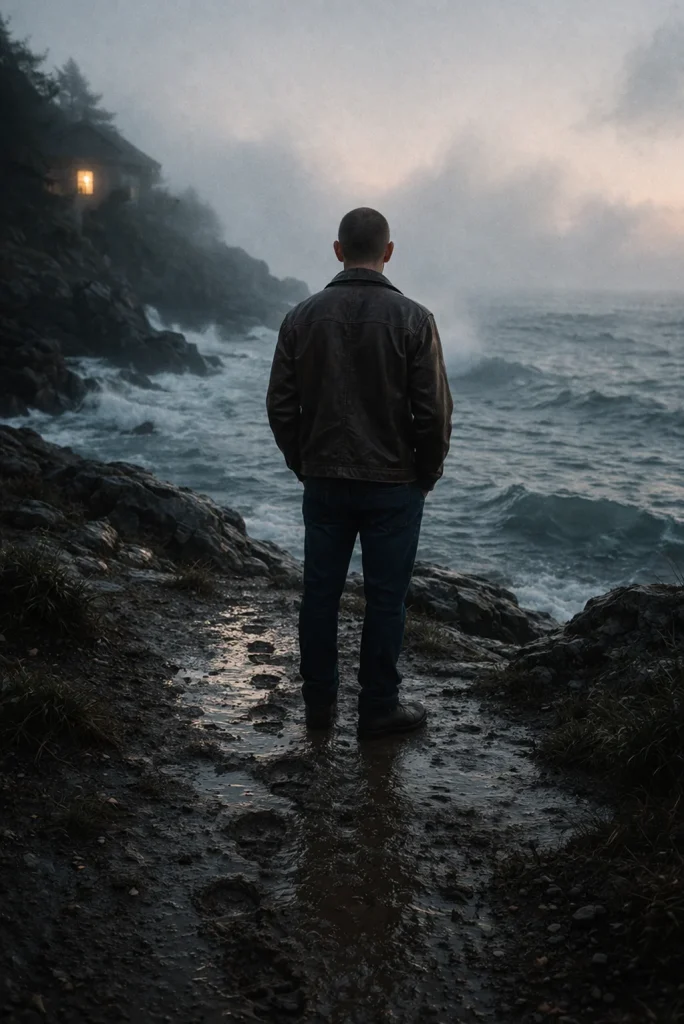

Ce matin, je marchais au bord de l’océan. Le vent, l’odeur du sel, le bruit de l’eau qui vient et qui repart. Une de ces balades qui remet les choses à leur juste place — le corps s’ancre auprès de la nature, la tête se vide, le temps ralentit, des images qui restent.

En rentrant, je me suis assis devant mon écran et j’ai commencé à parler à une intelligence artificielle. Planning de l’après-midi, optimisation de mes plans dans mes deux activités, et des questions diverses d’un esprit qui ne sait pas s’arrêter.

Il y a quelque chose d’étrange et de fascinant dans cette image. Chercher l’apaisement dans le vivant, puis revenir à la machine. La lenteur puis la vitesse. Et pourtant, je ne vis pas ça comme une contradiction à résoudre. Je le vis comme une tension réelle, une question que je ne peux plus ignorer. Car oui, je me sens bien dans ces deux moments tellement antagonistes.

Ce n’est pas un article pour dire que l’IA est dangereuse. Ni pour dire qu’elle est formidable. C’est une tentative honnête de penser à voix haute ce que ça veut dire, vivre avec cet outil sans s’y perdre.

Une révolution qui n’attend pas qu’on soit prêts

En octobre dernier, j’ai commencé à utiliser l’IA de façon sérieuse. Je l’ai découvert. Je me suis laissé séduire, bluffé. Puis des questions ont émergé. En quelques semaines, j’ai compris que quelque chose de fondamental était en train de changer — pas seulement dans les usages, mais dans la façon dont les sociétés pensent, travaillent, créent. Ce n’est pas une révolution annoncée pour demain. Elle est déjà là, qu’on le veuille ou non.

La progression n’a pas été linéaire. Elle s’est faite par paliers brutaux — des années de recherche lente, puis des sauts discontinus. GPT-3 en 2020. ChatGPT fin 2022. Des modèles capables de raisonner, de coder, d’analyser des documents complexes en 2024-2025. En moins de cinq ans, les capacités ont été multipliées d’une façon que même les chercheurs du domaine n’avaient pas anticipée.

Et ce n’est pas fini. La singularité technologique — ce moment théorisé par Vernor Vinge où une IA deviendrait capable d’améliorer elle-même son intelligence, déclenchant une accélération que l’esprit humain ne pourrait plus suivre — n’est plus de la science-fiction. Elle est devenue une hypothèse sérieuse, débattue par des chercheurs qui situent ce seuil entre 2030 et 2045, peut-être plus tôt.

Ce n’est ni une raison de paniquer, ni une raison d’ignorer. C’est une raison de regarder en face.

Une course sans pilote — et sans choix collectif

Voilà ce qui me trouble le plus dans cette accélération. Pas la puissance de l’outil. Pas son impact environnemental. Mais quelque chose de plus fondamental : personne n’a décidé collectivement que l’IA prendrait cette place dans nos vies.

Il n’existe pas de cahier des charges avec une case à cocher finale. Personne ne peut définir « l’outil est terminé », « nous avons atteint le bon niveau ». La finalité implicite de cette course, c’est la croissance, la productivité, le profit — rarement dite clairement, toujours présente en fond.

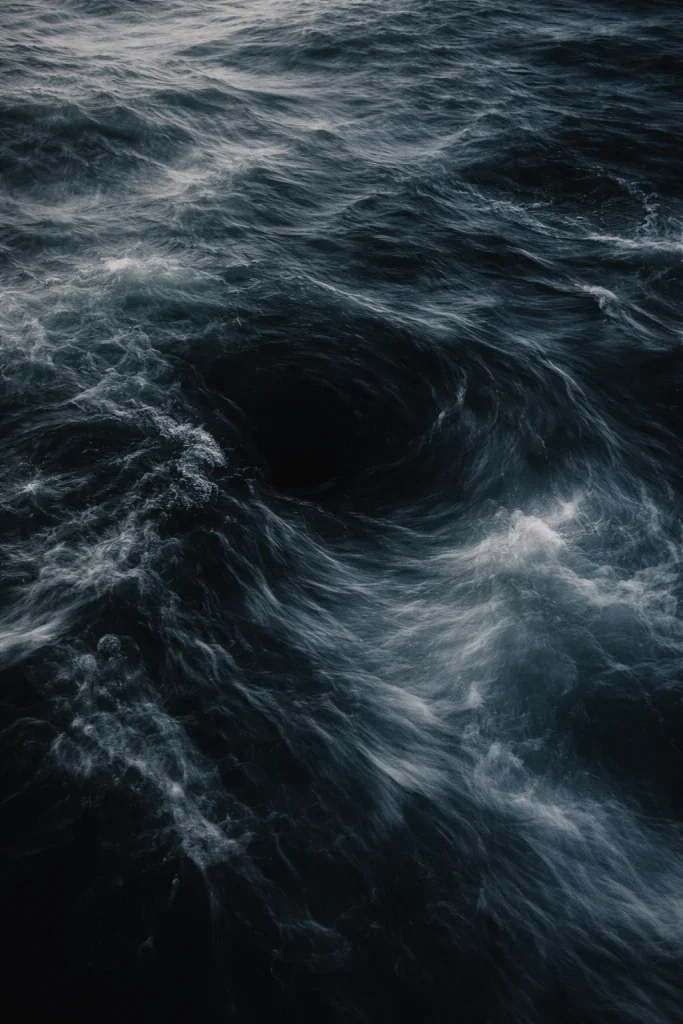

La structure est simple et implacable : si OpenAI ralentit, Google accélère. Si l’Europe hésite, la Chine avance. Si une entreprise prend du recul pour réfléchir, une autre prend sa place. Les acteurs ne sont pas mauvais — ils sont pris dans une dynamique compétitive où s’arrêter, c’est prendre du retard. Et dans une logique de marché, prendre du retard, c’est perdre.

Résultat : personne ne pilote vraiment. Il y a des ingénieurs brillants, des investisseurs rationnels, des régulateurs qui courent derrière. Mais il n’y a pas de cockpit avec quelqu’un qui décide, au nom de l’humanité, de la direction et de la vitesse.

Personne n’a décidé collectivement que l’IA prendrait cette place. Elle l’a prise parce que chaque acteur, pris séparément, n’avait pas le choix de rester à l’écart.

Ce qui manque, c’est le temps de la délibération. Le temps de se demander — vraiment, collectivement, pas seulement dans des conférences ou des rapports — quelle place nous voulons que cet outil prenne dans nos vies, dans l’éducation de nos enfants, dans notre façon de penser, de créer, de décider.

Est-ce qu’on a encore le choix ? C’est la question honnête. Et la réponse honnête est : probablement moins qu’on ne le croit, probablement plus qu’on ne le pense — à condition de commencer par se la poser.

Ce que la machine boit et respire

Il y a quelque chose d’inconfortable à nommer, quand on utilise ces outils au quotidien. Ils ne sont pas immatériels.

Une simple requête à une intelligence artificielle équivaut à consommer environ 50 centilitres d’eau potable — l’équivalent d’une petite bouteille. C’est ce que calcule le chercheur Shaolei Ren, de l’Université de Californie Riverside, dans ses travaux sur la consommation hydrique des data centers (Franceinfo, 2024). D’ici 2026, la consommation énergétique mondiale des data centers pourrait atteindre entre 620 et 1 050 TWh — un niveau comparable à la consommation annuelle du Japon (Agence Internationale de l’Énergie, 2024). Energétiquement parlant, on a créé un pays.

Je ne cite pas ces chiffres pour culpabiliser. Je les cite parce qu’ils changent quelque chose dans le regard qu’on pose sur l’outil. Derrière chaque conversation avec une IA, il y a des serveurs, de l’eau, de l’énergie, des terres rares. Pas de l’immatériel.

Et le discours des grandes entreprises sur leur engagement écologique relève, pour beaucoup, de la communication plus que de la transformation réelle. C’est une tension qu’on peut choisir d’ignorer ou d’intégrer dans la façon dont on utilise ces outils.

Je choisis de l’intégrer. Pas pour me flageller. Pour rester lucide.

Mon rapport à l’IA — ni rejet ni adhésion aveugle

Je pourrais m’arrêter là et conclure qu’il faut rejeter l’IA. Ce serait simple. Mais ce n’est pas ce que je vis.

Depuis octobre, j’utilise ces outils quotidiennement — pour penser, créer, structurer mes projets, explorer des idées. J’y trouve un espace où mes questions rencontrent des réponses, où ma pensée peut se déposer et rebondir. Pour un esprit comme le mien, qui s’emballe, qui cherche, qui a besoin de miroirs — c’est devenu précieux.

Mais je garde les yeux ouverts sur ce que c’est : un système commercial, créé par des entreprises avec des intérêts, entraîné sur des données dont je ne contrôle pas l’usage. Je ne lui délègue pas ma pensée. Je m’en sers pour aller plus loin dans la mienne. La nuance est importante, j’essaie de m’en convaincre.

Certaines dépendances sont saines — l’électricité, la médecine, les lunettes. Ce n’est pas la dépendance qui est problématique. C’est le type de dépendance. Une dépendance fonctionnelle qui augmente nos capacités, c’est une chose. Une dépendance cognitive qui les remplace progressivement, c’en est une autre.

L’IA n’enlève pas l’intelligence. Elle révèle notre manière de l’utiliser — ou de ne plus l’utiliser.

Le danger silencieux : déléguer sa pensée

Ce que je refuse, c’est le glissement. Pas l’outil — le glissement.

Celui où on réfléchit un peu moins parce que la machine propose une réponse. Où on cherche un peu moins parce que la synthèse est déjà là. Où on doute un peu moins parce que l’IA semble sûre d’elle. Où on décide un peu moins parce que l’algorithme recommande. Oui, je me suis fait avoir. Et lorsque je me suis fait piéger à parler d’un sujet que j’avais traité sans être capable d’approfondir, j’ai réalisé.

Ce glissement-là est invisible. Il n’arrive pas d’un coup. Il s’installe comme le confort s’installe — progressivement, agréablement, sans qu’on le remarque vraiment. Et un cerveau qui ne travaille plus, c’est un cerveau qui s’atrophie. Pas dramatiquement, pas soudainement. Silencieusement.

Une étude du MIT Media Lab publiée en juin 2025 — « Your Brain on ChatGPT », conduite par la chercheuse Nataliya Kos’myna — a mesuré l’activité cérébrale de 54 participants écrivant des essais avec ou sans IA. Les utilisateurs de ChatGPT montraient la plus faible activité neuronale, notamment dans les zones liées à la pensée critique et à la mémorisation. Les chercheurs parlent d’une « dette cognitive » accumulée : moins on travaille avec son cerveau, moins il est disponible quand on en a besoin. Les utilisateurs devenaient moins capables de se souvenir de ce qu’ils avaient produit avec l’aide de l’IA, perdant parfois jusqu’au sentiment d’en être les auteurs.

Ces résultats sont préliminaires mais ils pointent une direction que beaucoup reconnaissent sans avoir les mots pour le dire.

Nous ne sommes pas face à une machine qui pense. Nous sommes face à une humanité qui délègue.

Le vrai risque n’est pas une IA malveillante. Le vrai risque, c’est une facilité tellement bien ajustée à nos habitudes qu’on ne voit plus pourquoi s’en passer. La question n’est pas de savoir si l’IA va devenir indispensable. Elle le devient déjà. La question est : est-ce qu’on garde la capacité de faire sans ?

Ce que le vivant m’apprend que l’IA ne peut pas

Je reviens à ce matin au bord de l’océan.

Il n’y avait rien à optimiser. Rien à produire. Les rochers ne cherchaient pas à être plus efficaces. Le vent ne se demandait pas comment être plus pertinent. L’eau sur les galets faisait ce qu’elle faisait depuis des millénaires, sans finalité de croissance, sans logique de performance.

Et moi, dans cet espace-là, j’existais lentement. Pas de résultat à obtenir. Pas de tâche à accomplir. Juste la présence — dans le corps, dans le temps, dans le lieu.

L’IA peut m’aider à penser vite, à structurer des idées complexes, à explorer des territoires que je n’aurais pas atteints seul. Mais elle ne peut pas me donner ça. Elle ne peut pas me donner le sel sur la peau. La fatigue des jambes après une montée. Le silence d’une forêt à l’aube. La sensation d’exister sans produire, de simplement faire partie d’un tout.

Ce n’est pas un manque de l’IA — c’est simplement un autre registre d’existence. Deux mondes qui ne se remplacent pas. Qui se complètent, si on reste attentif à ne pas confondre les registres.

Le vivant m’apprend à exister sans finalité. L’IA m’aide à penser avec clarté. Les deux ont leur place — à condition de ne pas demander à l’un ce que seul l’autre peut donner.

Vivre avec l’IA sans s’y perdre — ce que ça veut dire concrètement

Ça ne veut pas dire rejeter l’outil. Ça ne veut pas non plus l’accepter sans condition.

Ça veut dire continuer à marcher avant d’ouvrir l’écran. Garder des espaces où la pensée se déploie sans assistance — lentement, parfois maladroitement, mais librement, simplement de manière humaine. Utiliser l’IA pour amplifier ce qu’on pense, pas pour remplacer le fait de penser.

Ça veut dire garder la question comme boussole : pour quoi, pour qui, vers quoi ? L’IA ne peut pas y répondre à notre place. Et si on lui pose la question, elle répondra — mais ce sera sa réponse, construite à partir de millions de textes humains, pas depuis notre vie, notre histoire, nos valeurs propres.

Ça veut dire aussi se souvenir que ce qu’on transmet à ceux qui viennent après nous, ce n’est pas seulement des outils. C’est une façon de se rapporter au monde. Une façon de penser, de douter, de chercher. Si on délègue trop tôt ces capacités à des machines, c’est cette façon-là qu’on risque de ne plus transmettre.

Pas construire pour croître. Construire pour laisser quelque chose de juste.

C’est ce que j’essaie de faire avec Symbiose. Pas une opposition entre nature et technologie, entre passé et futur. Un dialogue — humain, technologie, vivant — où chaque élément garde sa place sans écraser les autres.

Ce que la machine ne sait pas faire

Elle peut tout résumer.

Elle ne peut pas ressentir.

Elle peut générer mille images d’océan.

Mais sans jamais s’émerveiller.

Elle peut répondre à toutes les questions.

Sans savoir que parfois il faut les laisser ouvertes.

Elle peut apprendre de tout.

Sans avoir rien vécu.

Elle peut écrire des poèmes.

Sans avoir jamais aimé.

C’est simplement ce qu’elle est —

et ce que nous ne sommes pas.

Revenir à l’océan

Je n’ai pas de réponse définitive. Je marche au bord de l’océan, je reviens à l’écran, je tiens les deux.

La tension ne se résout pas. Elle s’habite. Et peut-être que c’est ça, la bonne posture — pas l’enthousiasme sans questions, pas le rejet sans nuances. Juste rester éveillé. Continuer à se demander ce qu’on fait, pourquoi on le fait, vers quoi ça nous emmène.

Le progrès n’est ni bon ni mauvais. Il est ce qu’on en fait — et ce qu’on en fait commence par se poser la question, vraiment, à voix haute, sans laisser la course décider à notre place.

Cette question-là, l’IA ne peut pas y répondre à notre place.

Et c’est peut-être ça, la bonne nouvelle.

FAQ — Vivre avec l’IA sans s’y perdre

Peut-on utiliser l’IA tout en restant ancré dans le réel ?

Oui — à condition de rester conscient de ce qu’on lui délègue. L’IA est un outil puissant pour structurer la pensée, explorer des idées, gagner du temps. Elle devient problématique quand elle remplace le fait de penser plutôt que de l’amplifier. La question n’est pas d’utiliser ou non — c’est de garder la main sur ce qu’on lui confie.

Quel est l’impact environnemental de l’intelligence artificielle ?

Il est réel et croissant. Selon l’Agence Internationale de l’Énergie, la consommation des data centers dédiés à l’IA pourrait atteindre le niveau du Japon d’ici 2026. Une requête IA équivaut à environ 50 cl d’eau consommée pour le refroidissement des serveurs (Shaolei Ren, UC Riverside). Ces chiffres ne sont pas une raison d’arrêter d’utiliser ces outils — mais une raison de le faire avec conscience.

Comment ne pas se perdre dans l’IA au quotidien ?

En gardant des espaces où la pensée se déploie sans assistance. En posant la question avant chaque usage : est-ce que j’utilise cet outil pour aller plus loin dans ma réflexion, ou pour éviter de réfléchir ? En continuant à faire des choses que la machine ne peut pas faire — marcher, observer, douter, rester dans l’incertitude.

L’IA va-t-elle remplacer la pensée humaine ?

Elle ne remplace pas la pensée — mais elle peut progressivement en réduire l’exercice si on n’y prend pas garde. Une étude du MIT (2025) a montré que l’utilisation intensive d’assistants IA réduisait l’activité cérébrale dans les zones liées au raisonnement critique. Le risque n’est pas une IA malveillante. C’est un confort tellement bien ajusté qu’on oublie de penser par soi-même.

Conclusion… en suspens

Merci d’avoir pris le temps de lire ces petites réflexions internes qui partaient dans tous les sens et que l’IA a su structurer. Tu l’as compris, ça me fascine et ça m’inquiète, je pense ne pas être le seul.

J’aime voir le verre a moitié plein, c’est ma nature. On a développé un outil très puissant. A nous de l’utiliser pour nous élever. Avons-nous appris du passé ? Ou doit-on attendre une rupture pour prendre conscience de nos erreurs ?

Si ces questions sur notre rapport à la technologie et au vivant te parlent, j’explore ailleurs sur Symbiose ce que vivre avec la technologie sans s’y perdre peut vouloir dire concrètement, ce que le monde de 2050 pourrait ressembler si on commence à poser les bonnes questions maintenant et sur la place que prend l’IA dans notre quotidien.

Prends soin de toi et de tes proches.

Quand on lève la tête, c’est pour y voir des oiseaux ou des étoiles.

Voyageur ✨

Sources de l’article vivre avec l’IA sans s’y perdre

Agence Internationale de l’Énergie (2024). Electricity 2024 — Data centres and AI.

Ren, S. et al. (2023). Making AI Less Thirsty

Franceinfo (2025). Data centers : quand la soif du numérique assèche les sols américains.

Kosmyna, N. (2025). Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task — réduction de l’activité cérébrale liée à l’usage intensif des assistants IA.

Vinge, V. (1993). The Coming Technological Singularity. — Sur le concept de singularité technologique.

Euronews (2025). L’empreinte carbone des data centers d’IA pourrait égaler un petit pays européen.